Félix Tréguer, chercheur au CNRS, à propos de StopCovid et des techniques de surveillance informatique.

paru dans lundimatin#239, le 20 avril 2020 Appel à dons Lundimatin est sensible à tout ce qui dans le confinement d’aujourd’hui préfigure le désormais fameux « jour d’après ». Et ne compte pas l’imaginer à partir des seules déclarations d’intentions – dont la courbe est exponentielle. Nous débutons donc une série d’entretiens avec quelques personnes dont nous pensons qu’elles ont depuis leur point de vue une bonne appréciation des dynamiques qui étaient déjà en cours en terme de mutation du travail, de l’économie, de l’informatique, du droit, de l’environnement, etc. Il s’agira à chaque de fois de partir de la situation de l’épidémie et du confinement, et de dérouler le fil. Ainsi, dans cette interview avec Félix Tréguer, militant à la Quadrature du net et auteur de L’utopie déchue – Une contre-histoire d’Internet, nous sommes partis des projets gouvernementaux de traçage et de surveillance des relations sociales. Ce qui nous a amenés, vous le verrez, à aborder plus généralement la question de l’informatisation de la surveillance, des liens entre GAFAM et Etats, des comparaisons possibles entre dictatures et démocraties libérales, et bien sûr des marges de manoeuvre qu’il nous reste pour empêcher demain d’advenir.L’épidémie de Covid-19 est l’occasion de la mise en place de techniques de traçage et de surveillance par des moyens numériques apparemment inédites, en tout cas à ce genre d’échelle. Dans la longue histoire de la surveillance des corps et des populations humaines, est-ce que cet événement vous en évoque d’autres ?En Europe, on avait un peu oublié les liens intimes qui unissent la raison d’État et la rationalité médicale. Alors qu’en Asie, à Taïwan par exemple, l’alliance entre appareils policiers et politiques sanitaires s’était déjà donnée à voir clairement à partir le début des années 2000, à l’occasion des épidémies du SRAS et du H5N1 (comme les mises en quarantaines forcées et la gestion de la crise par le pouvoir militaire).

Mais en effet, les parallèles historiques sont nombreux : à travers l’histoire, les crises sanitaires, lorsqu’elles n’ont pas entraîné la chute des États, ont été des moment d’hypertrophie, générant de nouveaux dispositifs de contrôle, ou légitimant et amplifiant de techniques de pouvoir préexistantes. On peut penser aux épidémies de peste, notamment à Marseille en 1720-1722 : les autorités multiplient alors les mesures de fichages des populations, et la crise offre en quelque sorte un condensé de pratiques et de savoir-faire policiers alors en plein développement.

Il y a dans ces épisodes des résonances évidentes avec ce nous connaissons aujourd’hui, avec la différence que les approches sécuritaire contemporaines s’appuient massivement sur l’informatique. Et en la matière, l’autre type de crise auquel fait écho la situation présente, c’est bien sûr le 11 Septembre 2001. La crise antiterroriste est alors l’occasion pour les polices les plus avant-gardistes de faire adopter des mesures de surveillance d’Internet, ou de faire proliférer des fichiers informatiques et de croiser massivement les bases de données. Des projets de surveillance numérique qui étaient dans les cartons depuis quelques années bénéficient alors d’un gigantesque coup d’accélérateur. Les résistances chez les responsables politiques comme dans l’opinion sont vaincues, des moyens budgétaires nouveaux sont alloués. Aux États-Unis, la NSA peut ainsi mettre en branle de nouveaux programmes de surveillance massive comme le fameux « Total Information Awareness ». En Europe, les États en profitent pour imposer aux opérateurs télécoms de stocker l’historique des communications de l’ensemble de la population.Il faut donc relever ce que l’informatisation permet de nouveau en matière de surveillance. Il y a certainement une question d’échelle avec l’apparition de capacités de stockage d’écritures quasi infinies, mais ce n’est peut être pas le point le plus notable. Fait-on face à un changement de paradigme ? Est-il à chercher du côté du traitement automatisé de la collecte des données ? Pour ma part, je résiste un peu à l’idée d’un changement de paradigme dans la surveillance, cette vieille pratique ancrée dans la raison d’État et qui permet au pouvoir de connaître ce qui est gouverné, d’identifier les risques et de réduire la part d’incertitude, pour s’adapter en conséquence. La crise sanitaire en cours ne me semble pas tant préfigurer un nouveau modèle de surveillance qu’elle n’amplifie les formes de surveillance déjà bien installées, et qui en tirent de nouvelles justifications. À mon sens, ce à quoi on assiste, c’est plutôt l’accentuation de la gouvernementalité libérale et du régime sécuritaire qu’avait déjà analysés quelqu’un comme Michel Foucault et à sa suite Gilles Deleuze dans son fameux texte sur les « sociétés de contrôle » : cette idée d’un gouvernement en temps réel des flux et d’une population en mouvement, à travers la mesure de ses qualités naturelles, de ses désirs, de ses affects et l’identification de corrélations statistiques. Comme le dit Foucault, le régime sécuritaire ce n’est plus tant le « faire vivre et laisser mourir » des sociétés disciplinaires que le principe du « laisser faire, passer et aller ».

Dans ces logiques qui coexistent encore et toujours avec les logiques disciplinaires et formes de coercitions plus archaïques encore, la nouveauté tient en effet au passage à l’échelle que permet l’informatisation de la société, au fait que la gestion en temps réel des flux et de leurs composantes est non seulement techniquement possible, mais que grâce à la baisse du coût du stockage et du traitement des données, il devient aussi économiquement soutenable de la pratiquer de manière plus systématique. Ce passage à l’échelle résulte de logiques endogènes à l’innovation technologique. Mais il est aussi évidemment très lié à des imaginaires sociaux et aux besoins qui en découlent. En l’occurrence, dans l’histoire moderne, tout un tas d’instruments dédiés au traitement de l’information – postes, télégraphe optique, fiches, … – se sont succédés pour outiller les bureaucraties et donner corps au vieux projet déjà présent chez Hobbes d’un gouvernement parfaitement huilé, organisé sur le modèle de la machine. Dès le XVIIe siècle, chez ces penseurs de l’État moderne, on retrouve cette idée à l’origine de la dégénérescence de la politique moderne, et que le philosophe Cornelius Castoriadis rattache à la volonté d’une maîtrise rationnelle du monde, où la rationalité apparaît comme parfaitement objectivable et donc, comme il l’écrit dès 1990, « algorithmisable » [1].

La tendance à l’automatisation gouvernementale vient donc de loin. Ce qui passe aujourd’hui pour de l’« intelligence « artificielle » – même si ces technologies sont encore inabouties et reposent énormément sur des opérateurs humains [2] – continuent de nourrir ce fantasme de décisions bureaucratiques plus objectives, réduisant la marge d’interprétation dans la construction des métriques, dans l’analyse des données, dans la prise de décision. Bien souvent ça ne marche pas, parce que les technologies ne sont pas au point, parce qu’il y a aussi des erreurs fondamentales au plan méthodologique. Mais de fait, grâce à l’informatique, on peut envisager de construire des bureaucraties plus vastes et plus efficaces – plus rapides, plus massives – en réduisant à portion congrue le rôle joué par les opérateurs humains, en les faisant tourner avec des fonctionnaires moins nombreux et plus précaires.Cette automatisation permet de résoudre, en apparence en tout cas, la première des critiques (formulées dans les démocraties libérales) : « que se passera-t-il si ces moyens tombent entre de mauvais mains – sous-entendu un gouvernement dictatorial ». Ici la décision est de toute manière reportée sur des dispositifs techniques. Ce sont les algorithmes qui « décident ». Et on prétend d’ailleurs – on le voit encore dans le cas de l’application StopCovid dont on reparlera – pouvoir leur mettre des « gardes-fous » techniques. Pour le dire autrement : contre-qui se bat-on exactement en matière de surveillance ? Mais comment ces algorithmes décident-ils ? La technologie n’est pas neutre : elle est conçue et déployée dans un système de relations de pouvoir vis-à-vis desquels elle n’est pas autonome ; elle retranscrit des pratiques et des rationalités qui en conditionne les effets. Par exemple, Parcoursup propose de rendre plus « objectif » le placement des bacheliers dans l’enseignement supérieurs alors qu’il aggrave les inégalités sociales. Ou lorsque le fisc décide d’utiliser des algorithmes pour surveiller les réseaux sociaux et détecter la fraude fiscale, ce n’est pas juste une question de vie privée ou de données personnelles. C’est le résultat de la suppression de postes de contrôleurs fiscaux et donc de logiques austéritaires. C’est aussi une manière de poursuivre la « chasse aux pauvres » en repérant les personnes qui se font un peut d’argent au noir en vendant des biens ou des services sur Le Bon Coin.

Depuis les années 1960, dans les discours dominants sur les dangers de l’informatique – et malheureusement cela concerne nombre des acteurs qui s’inscrivent dans la défense des libertés numériques –, cette réalité-là est trop souvent mise de côté. On se contente du débat sur les procédures ou les gardes-fous appropriés, qu’ils soient éthiques (avec par exemple des chartes à destination des informaticiens), juridiques (la protection des données personnelles ») ou technologiques (la cryptographie et le « privacy-by-design »). Et ce sont ces gardes-fous qui sont censés distinguer les régimes libéraux de leurs cousins plus franchement autoritaires. Sauf qu’en pratique, tenter de contenir une ligne de code et ses usages par des procédures, aussi bien pensées soit-elles, cela ne tient jamais bien longtemps. Elles sont rapidement désarmées, contournées, oubliées, ou tout simplement tombent en désuétude. Même si le débat sur les garde-fous ne peut pas être totalement délaissé, il faut l’articuler à une critique de l’informatisation en tant que processus bureaucratique et battre en brèche l’imaginaire gestionnaire et anti-démocratique dont elle découle et qu’elle imprime dans la société.

J’en reviens à la question : contre qui se bat-on ? On se bat contre des acteurs, des pratiques, des discours, qui déclinent ces imaginaires. Pour donner un exemple : avec les amies de La Quadrature du Net, on a lancé en septembre dernier une campagne participative de recherche-action baptisée Technopolice.fr. Le point de départ, c’est la prise de conscience que l’informatique de contrôle contre laquelle on se bat depuis des années sur Internet migre dans l’ensemble de la société, notamment dans les villes – un autre type d’espace public sur lequel il nous a semblé important de nous mobiliser. À l’ère des Smart City, la surveillance « Big Data » s’inscrit dans la police du quotidien. Et ce que l’on cherche à documenter et à contrer, ce sont les élus, les chefs de service, les commerciaux des grandes boîtes comme Thales ou les startups liées à ces projets de police prédictive ou de vidéosurveillance automatisée. Ce sont leurs programmes qui veulent bâtir une ville parfaitement administrée, aseptisée, maîtrisée, contrôlée, sans vie, étouffée par la gestion bureaucratique ; ce sont les politiques de recherche et développement, qui sont mises en œuvre dans les laboratoires d’informatique appliquée, à travers des expérimentations grandeur nature qui essaiment à travers le monde, puis de grands programmes de rénovation urbaine qui nous vendent l’utopie des métropoles clinquantes et hyperconnectées.

Dans ces luttes, s’enfermer sur l’enjeu des garde-fous à la surveillance sans tacler les logiques sous-jacentes condamne la critique à une efficacité bien trop limitée. Par exemple, si l’on veut combattre efficacement la reconnaissance faciale, on ne peut pas se contenter de dire « il faut des bons garde-fous pour éviter les abus ». À la prochaine crise, qu’elle soit antiterroriste ou sanitaire, on peut être à peu près sûr que ces garde-fous seront balayés d’un revers de main. Le problème de la reconnaissance faciale est plus profond : cette forme de surveillance biométrique n’est que la dernière incarnation de logiques policières et gestionnaires plus anciennes qu’il faut parvenir à déchiffrer et à dénoncer.Lors de sa première prise de parole sur un éventuel dispositif de « tracking » le ministre de l’Intérieur Christophe Castaner affirmait :« ce n’est pas dans notre culture ». Est-ce que c’est si vrai ? En quoi la France serait-elle rétive à la surveillance de l’ensemble de sa population ? D’un côté le pays n’a jamais rendu obligatoire la carte d’identité. Et pourtant depuis quelques années beaucoup de certitudes à ce sujet ont été balayées (sur la question de la Carte d’identité justement). Est-ce un tiraillement récent ? Je ne nous vois pas plus rétifs que d’autres, même si l’idée de « Français indisciplinés » est apparemment à la mode ces temps-ci. C’est vraiment se moquer du monde. Quand Castaner ou Thierry Breton, commissaire européen et fer de lance de la gestion de crise sanitaire par la surveillance numérique, évoquent la spécificité de la culture française ou européenne en matière de surveillance, c’est surtout une manière pour eux de se distinguer de la Chine. C’est doublement problématique : d’une part, ils font preuve d’un relativisme culturel choquant en faisant comme si la « culture chinoise » serait prédestinée au contrôle techno-sécuritaire, comme s’il n’y avait pas aussi en Chine de nombreuses formes de résistance ; et d’autre part, à travers ces discours, ils font comme s’ils pratiquaient une gestion de crise fondamentalement différente. En réalité, ils imitent très largement les stratégies déployées par les autorités chinoises dès le mois de février, et le principal enjeu pour eux consiste à trouver des modalités plus « acceptables », d’apparence plus libérale.

Quelque part, en tenant ces discours proto-racistes sur une supposée spécificité culturelle chinoise, Castaner et Breton entretiennent la petite histoire qu’on aime tous se raconter pour se rassurer. Car on n’arrête pas de jouer à se faire peur avec la Chine et ses technologies de contrôle – la reconnaissance faciale, ses policiers avec des lunettes de réalité augmentée, etc. – en se disant « tout de même, c’est très inquiétant, mais heureusement nous n’en sommes pas là ». Alors qu’en fait, on suit à peu près le même chemin, avec cinq ou dix ans de retard. Entre les pratiques de surveillance que l’on connaît en France et la Chine, c’est bien plus une différence de degré que de nature. Quant aux résistances populaires, qu’on passe systématiquement sous silence lorsqu’on évoque le cas chinois, elles existent en France, mais pas un degré tel qu’on puisse s’en targuer. Alors certes, la carte d’identité n’est pas obligatoire en France alors qu’elle l’est en Chine. Mais c’est l’aspect un peu pernicieux du gouvernement libéral de sociétés très bureaucratisées : l’État n’a pas besoin de prendre le risque d’un énième procès en atteinte à la vie privée en la rendant obligatoire. Il suffit de la rendre suffisamment pratique dans la vie quotidienne pour qu’elle devienne quasiment incontournable, produisant les effets politiques escomptés tout en évitant au pouvoir de passer pour un régime autoritaire.

C’est ce que des informaticiens militants de longue date comme Eben Moglen ou Philippe Aigrain désignent sous l’expression de « dictature de la commodité ». Elle fonctionne depuis des années avec la carte d’identité plastifiée. Et c’est encore la stratégie que poursuit aujourd’hui le gouvernement avec son application Alicem, une application pour smartphone qui permettra de s’authentifier par reconnaissance faciale pour accéder aux services publics numériques. Montrer son visage devant la webcam de son smartphone ou de son ordinateur, c’est a priori bien plus rapide et pratique que d’avoir à retenir son nom d’utilisateur et son mot de passe. Et c’est sur cela que compte l’État pour imposer doucement la reconnaissance faciale comme mode d’identification. À partir d’août 2022, le ministère de l’intérieur commencera d’ailleurs à déployer la carte nationale d’identité électronique (CNIE), suivant des spécifications prévues par l’Union européenne à travers un règlement adopté en juin 2019. La puce de cette carte contiendra notre empreinte faciale et pourra à terme être utilisée pour s’identifier à travers la reconnaissance faciale, lors de contrôle policiers dans la rue ou dans différents guichets. La crise du Covid-19 risque d’ailleurs de participer à légitimer ces déploiements : outre la praticité, on vantera aussi l’aspect « sans contact » de la reconnaissance faciale, comme le fait déjà la police aux frontières étasunienne en expliquant que, en contexte pandémique, la reconnaissance faciale est plus « hygiénique » que les papiers d’identité.

Apple et Google ont annoncé qu’ils mettront à disposition des autorités en mai une base technique commune pour les applications de traçage. On peut se demander si ce ne sont pas eux les grands gagnants. Ils rappellent d’un côté à quel point ils sont des acteurs importants de la gouvernance – alors qu’ils semblaient plutôt en retrait au début d’une crise qui a vu le retour en force des Etats. Et ils comptent bien restaurer la confiance à leur égard et à l’égard du traçage – confiance pas mal érodée par les multiples scandales de cette dernière décennie. Ici, ils mettent en avant le même genre de garantie que celles auxquelles l’Etat français s’était résigné (décentralisation, anonymisation, etc.) Des entreprises comme Apple, mais surtout Google ou Facebook font en effet partie des grands gagnants de la crise alors que depuis des mois, leurs dirigeants étaient sous le feu des critiques. Dès le début de la pandémie, ils se sont présentés comme des partenaires naturels des États dans la gestion de crise, d’abord en mettant en avant des messages de sensibilisation sanitaire, ensuite en censurant les rumeurs et autres fausses nouvelles qui circulaient sur Internet à propos du virus.

Puis, fin mars, l’administration Trump a annoncé des pourparlers avec leurs responsables pour voir comment mettre à profit leurs vastes stocks de données de géolocalisation afin de modéliser les déplacements de la population. Les appels à l’aide se sont alors multipliés, y compris de la part de gens normalement normalement critiques à leur endroit. En Italie, dans le quotidien de gauche Il Manifesto, des journalistes ont par exemple publié une lettre ouverte estimant que les gigantesques bases de données des géants californiens étaient absolument nécessaires pour gagner la « guerre » contre le virus, notamment pour identifier les personnes les plus « dangereuses » du point de vue de la propagation de l’épidémie. Pour le moment, ces entreprises font preuve d’une certaine prudence, sans doute par peur de s’exposer à un nouveau scandale sur le terrain de la vie privée. Seules des statistiques agrégées ont été diffusées. En analysant l’historique de navigation du milliard d’utilisateurs de sa plateforme cartographique Google Maps, Google a par exemple publié des rapports sur les changements dans le comportement des populations de 131 pays afin de pointer les effets des mesures de « distanciation sociale ». Ces mesures mettent notamment en évidence la baisse de la fréquentation de certains lieux, comme les cafés ou les restaurants. Pas de gros scoop donc.

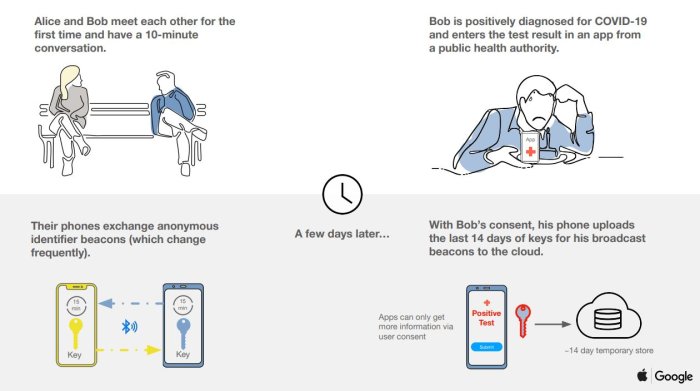

La crise sanitaire est aussi l’occasion pour ces groupes de se positionner sur le marché florissant des données de santé. Au Royaume-Uni, la branche « innovation » du National Health Service (NHS) a annoncé un partenariat avec un consortium dirigé par la société Palantir, connue pour vendre ses outils Big Data aux services de renseignement étasuniens ou français. Amazon, Microsoft ou Google en font aussi partie. Le but est de croiser tout un tas de données pour aiguiller la réponse à la crise sanitaire et affecter aux mieux ldes ressources hospitalières. Il y a aussi la question du backtracking, puisque Apple et Google – qui gèrent la quasi-totalité des systèmes d’exploitation pour smartphones – ont annoncé qu’ils allaient collaborer avec les autorités sanitaires pour permettre à ces application de traçage de contact d’être interopérables et plus précises.

À mon sens, toutes ces évolutions pointent dans le même sens, à savoir que les grandes plateformes fusionnent progressivement avec les États [3]. On l’a bien documenté à propos des politiques de censure sur Internet [4] mais le phénomène évidemment est plus large. En dépit de tous les discours qui mettent en scène la rivalité public-privé – avec cette idée que les gouvernements souverains tenteraient de juguler l’influence de ces grands acteurs californiens –, ou qui à l’inverse s’inquiètent de voir les « GAFAM » se substituer aux États, les grandes plateformes numériques sont de plus en plus intégrées aux politiques publiques. Il y a une certaine logique à cela : elles maîtrisent les réseaux sociaux et une grande partie d’Internet, ce sont les leaders de la recherche en intelligence artificielle, et surtout, ces acteurs sont les pionniers de la « gouvernance par les données », un paradigme qui après la mode de la « nouvelle gestion publique » dans les années 1980 est en train de transformer l’ensemble du champ bureaucratique. Ces entreprises détiennent les savoir-faire en la matière, et leur pouvoir d’attraction semble irrésistible pour les administrations publiques. Bien sûr, cette convergence public-privé est largement favorisée par des mécanismes de socialisation croisée entre élites, ou même des formes de collusions – par exemple au fait que des responsables publics soient recrutés par Google, ou que des cadres privés partent dans le public et importent leurs méthodes.

Et ce n’est pas propre aux « démocraties libérales » : en Chine aussi, on voit des processus similaires à l’œuvre, avec des collaborations très poussées entre le Parti communiste chinois et les grandes plateformes numériques comme Alibaba ou Tencent. Pour combattre l’épidémie, ces dernières ont par exemple déployé des fonctionnalités sur les applications smartphone les plus populaires du pays comme Alipay ou WeChat, afin d’enregistrer les déplacement de la population et en déduire un risque de contagiosité. Celui-ci est ensuite converti en code couleur, qui permet aux autorités d’imposer des mesures de quarantaine, ou filtrer les déplacements dans les villes. Mais là-bas aussi, il y a tout de même des rapports de force, des logiques de distinction entre acteurs publics et privés en fonction de leurs intérêts. Ces dernières années, ces grands groupes ont par exemple pu exiger de nouvelles lois visant à limiter les pouvoirs de surveillance du régime et mieux protéger la vie privée de leurs utilisateurs.D’ailleurs, si certaines entreprises ou certains États élaborent une éthique du traitement des données d’un côté et instaurent la confiance de l’autre avec des garanties techniques ou juridiques, pourquoi refuser le traçage ? Notamment en situation de crise sanitaire ? On en revient à la question de la confiance et des « garde-fous ». On nous explique en effet que dans sa version « éthique » et « démocratique », le backtracking sera utilisé sur la base du volontariat et que, grâce à des procédés cryptographiques, jamais les utilisateurs ne pourront être identifiés. Mais même introduits sur une base volontaire, avec une architecture technique protégeant la confidentialité des données, quelle garantie avons-nous qu’ils n’évolueront pas vers des logiques de surveillance plus attentatoires aux libertés ? Comment écarter le risque que ces applications ne soient un jour rendues obligatoires ? En Chine, bien que théoriquement utilisés sur la base du volontariat, des dispositifs similaires mis en place par Alibaba ou Tencent sont rapidement devenus nécessaires pour se déplacer. À l’occasion de différents points de contrôle disséminés dans les villes, chaque personne doit présenter son téléphone pour « pointer » et attester de sa « bonne santé » aux abords des lieux de travail, des transports publics ou même de de zones résidentielles. Surtout, l’efficacité réelle du backtracking pour lutter contre l’épidémie n’est nullement avérée. À Singapour, où l’application était initialement perçue comme responsable des bons résultats dans la lutte contre l’épidémie, le nombre de cas de Covid-19 a grimpé en flèche, au point que les autorités ont fini par imposer des mesures de confinement généralisé.

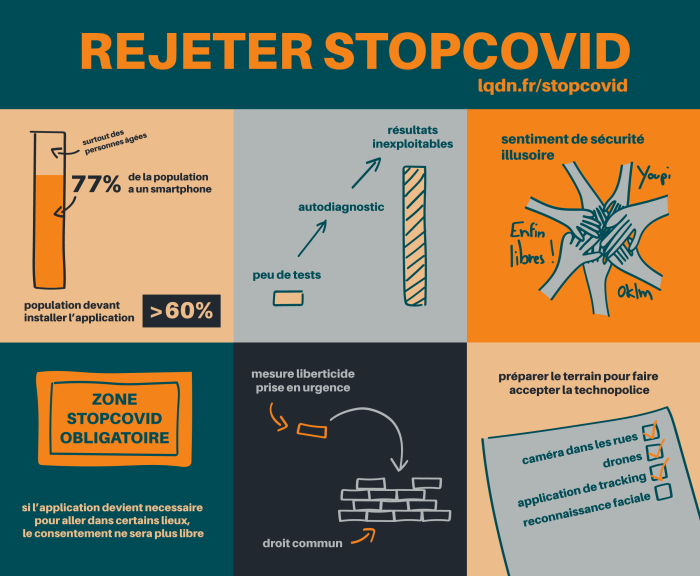

Les experts estiment qu’il faudrait au minimum que 60 % de la population y ait recours pour que ces solutions soient efficaces. Or, en France, près d’un quart de la population n’a pas de smartphone, que ce soit pour des raisons économiques ou idéologiques. Alors certes, les opérateurs télécoms proposent dores-et-déjà d’en distribuer gratuitement aux personnes qui n’ont pas les moyens de s’en acheter, mais on peut fortement douter que 60 % des gens soient en mesure d’utiliser l’application que leur prépare le gouvernement. Dans une enquête récente menée en France, 45 % des sondés affirme qu’ils refuseront d’installer l’application [5]. L’autre élément mis en avant par les études [6] sur le sujet, c’est qu’il faudrait mettre au plus vite à l’isolement les personnes qui ont été détectées à proximité d’une personne malade pour éviter le risque de nouvelles contagions. À quoi peut-on donc s’attendre ? Au moindre rebond des contagions, voyant que le backtracking « éthique » et facultatif n’est pas à la hauteur, le gouvernement pourrait chercher à le rendre plus « efficace » en le rendant non seulement obligatoire, mais aussi contraignant : il procéderait alors simplement à la levée du pseudonymat pour les personnes à risque histoire de les mettre en quarantaine le plus vite possible.

En plus de ce risque évident de dérive, il y a au moins un autre problème. Outre la contagion directe entre deux personnes au contact l’une de l’autre, le virus se niche aussi sur des surfaces – une modalité de transmission dont ces solutions sont incapables de rendre compte. Ces systèmes qui misent sur la peur des gens et les appellent à se rendre complice de leur propre surveillance, n’apporteront qu’un faux sentiment de sécurité. En invitant à faire confiance à la technologie, ils pourraient conduire à se détourner des pratiques de bon sens et présenter de ce fait un risque sanitaire. Même les ministres qui passent leur temps à préparer l’opinion au déploiement de cette application semblent douter de son efficacité. Mais comme ils n’ont pas de véritables autres solutions à proposer, ils préfèrent se faire les relais d’

une pensée magique où la technologie va pouvoir pallier à l’incurie des politiques de santé, en proposant un outil de surveillance « participatif » afin d’automatiser un mode de gestion technocratique du risque sanitaire. Il faut donc refuser le backtracking. À terme, c’est aussi une manière de rendre possible d’autres manière de s’occuper collectivement de notre santé, d’organiser le souci de soi et des autres. Car au-delà de l’enjeu des libertés et du contrôle,

l’autre problème du solutionnisme technologique réside aussi dans le fait qu’il se présente toujours comme la seule solution aux problèmes qu’il engendre, et que ce faisant il restreint complètement nos imaginaires politiques. Je parle de restaurer la confiance, et en même temps je n’ai pas évoqué la CNIL dont ce pourrait être le rôle. L’institution semble complètement dépassée. Ou alors est-ce simplement son rôle qui est mis en lumière ? D’ailleurs quel est-il, ce rôle ? Depuis quarante ans, la CNIL sert d’alibi bien commode à la fuite en avant sécuritaire. Créée en réponse à l’un des tous premiers scandales en matière de surveillance informatique – l’affaire SAFARI en 1974 –, elle n’a depuis cessé de voir ses pouvoirs rognés, pour se consacrer principalement à l’accompagnement « éthique » de l’innovation technologique. J’ai commencé des recherches sur cette institution, et mon hypothèse de travail, c’est que la CNIL a surtout pour effet de cantonner les controverses autour de l’informatique de contrôle en resserrant le débat sur d’obscures notions juridiques ou techniques – ces fameux « garde-fous » dont on parlait tout à l’heure – sans jamais interroger les logiques qui président à ces déploiements. Et si elle peut parfois aider à limiter les atteintes aux libertés, à créer des procédures qui sont autant de contraintes pour les organisations qui surveillent la population, elle est incapable de faire obstacle au déferlement techno-sécuritaire. Il y a des gens honnêtes et sincères qui travaillent au sein de cette institution, mais les quelques fois où ils parviennent à engager un vrai rapport de force avec le pouvoir administratif ou les milieux économiques, ceux-ci parviennent à contourner leur opposition ou saisissent l’occasion d’un texte de loi pour leur ôter des pouvoirs. La CNIL n’a tout simplement pas les moyens humains, juridiques ou politiques d’enrayer la raison d’État, ni la volonté de questionner la surenchère technologiqueJe voudrais revenir enfin à la question de l’automatisation de la surveillance – automatisation de la collecte mais surtout de son analyse et des décisions qui en découlent. Qu’est-ce que cela induit en terme de résistance ? Est-ce que la question c’est encore de pouvoir échapper au traçage ? Ou la question n’est-ce pas plutôt d’empêcher, de léser, de corrompre, le traitement de ces données ?Je viens d’un milieu militant et intellectuel qui a longtemps tressé des couronnes à Internet, en le présentant comme vecteur de progrès social et politique. Après dix ans à travailler sur ces enjeux, à essayer de retracer l’histoire de ces luttes, à prendre acte de nos nombreux échecs, j’en suis venu à comprendre que l’obstacle est d’abord dans nos têtes : le problème tient avant tout au rapport de fascination que notre civilisation toute entière entretient avec la technologie – une fascination largement entretenue par les discours des élites. Alors oui, il faut lutter pour défaire l’influence des grandes plateformes numériques en décentralisant Internet ; il faut augmenter le coût de la surveillance en recourant à des stratégies de dissimulation, par exemple à travers la cryptographie ; il faut dénoncer le gigantisme industriel du numérique et son coût écologique colossal, et bâtir des appareils et des réseaux « low-tech » [7]. Mais tout cela, il faut aussi l’articuler à une prise de conscience du fait que l’informatisation accentue les rapports de pouvoir, et pas seulement en terme de surveillance.

Pour lutter contre l’informatisation et échapper aux prises de décisions algorithmiques, il y a plein de manières de lutter. Elles existent déjà : les manifestes ou les manifestations contre la dématérialisation des services publics [8], les mobilisations contre Parcoursup, contre l’intelligence artificielle que Pôle Emploi s’apprête à déployer pour placer les chômeurs, ou contre la 5G. Tout cela participe d’une lutte plus globale à laquelle des collectifs comme La Quadrature du Net contribuent également, avec un pied dans les institutions – notamment dans les tribunaux à travers l’action juridique – et un pied en dehors, avec des actions de terrain menées en lien avec des militants de quartier, par exemple à travers la campagne Technopolice.fr. Je ne sais pas encore ce qui pourra permettre à ces fronts de lutte de passer à l’échelle eux-aussi et de renverser la donne, mais des liens se tissent. Au-delà des cercles militants, quelque chose comme un refus de la machine technocratique, du tout-numérique et de ses effets déshumanisants se fait sentir. C’est le cas par exemple chez des usagers de services publics confrontés aux affres de la dématérialisation, ou chez de nombreuses professions où l’informatisation toujours plus poussée apparaît comme dégradante et déqualifiante. Cette crise sanitaire et la réponse des États, qui nous invitent à remettre un jeton dans cette grande machine que l’on a vu caler sous nos yeux, qui vanteront l’intérêt du « tout-numérique » et du « sans-contact » pour faire proliférer leurs dispositifs techno-sécuritaires, pourrait à terme contribuer à amplifier le mouvement.

[1] https://lesamisdebartleby.wordpress.com/2018/10/30/cornelius-castoriadis-voie-sans-issue%E2%80%89/

[2] Voir à ce sujet l’interview publiée cette semaine dans lundimatin de Paola Tubaro

[3] https://halshs.archives-ouvertes.fr/halshs-01865140/document

[4] https://lundi.am/Vers-l-automatisation-de-la-censure-politique-Felix-Treguer

[5] https://www.laprovence.com/article/sante/5959756/une-majorite-de-francais-contre-une-application-obligatoire-de-type-stopcovid-sur-leur-telephone.html

[6] https://science.sciencemag.org/content/early/2020/04/09/science.abb6936?rss=1

[7] https://www.ritimo.org/Low-tech-face-au-tout-numerique-se-reapproprier-les-technologies-8264

[8] https://reporterre.net/Des-humains-plutot-que-des-machines-usagers-et-cheminots-contestent-la-numerisation-des

https://lundi.am/Le-solutionnisme-technologique-restreint-completement-nos-imaginaires

Commentaires récents